(3)AI의 눈과 귀

뉴스 원문 정보

원문 : https://milgyonews.net/news/detail.php?wr_id=40388작성 : 밀교신문

그동안 인공지능에게 세상은 거대한 도서관의 서고와 같았다. 기계는 인류가 남긴 방대한 텍스트를 학습했지만, 정작 창밖의 노을이 얼마나 붉은지, 빗방울이 지면에 닿을 때 어떤 궤적으로 부서지는지는 알지 못했다.

AI에게 사과란 ‘붉고 달콤한 과일’이라는 언어적 정의일 뿐, 손 안에서 느껴지는 묵직한 무게감이나 베어 물었을 때의 아삭한 질감으로 존재하지 않았다. 아무리 똑똑해져도 어딘가 공허하게 느껴졌던 이유는 바로 이 감각의 결여에 있었다. 인간의 지능이 물리 세계와의 충돌을 통해 완성된다는 점을 고려할 때, 언어라는 좁은 창에 갇힌 AI는 세상의 절반만을 읽고 있었던 셈이다.

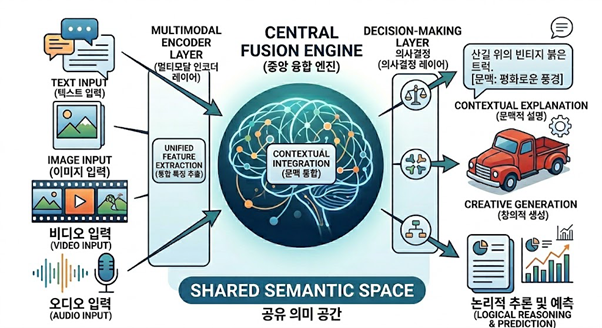

하지만 최근 등장한 멀티모달(Multimodal) AI는 이 언어의 벽을 허물기 시작했다. 텍스트를 넘어 이미지, 영상, 음성이라는 다양한 형태의 정보를 통합적으로 처리하게 된 것이다. 이것은 단순히 AI에 눈이 달렸다는 수준의 변화가 아니다. 세상을 이해하는 방식 자체가 근본적으로 확장되고 있다.

1. 텍스트를 넘어서: 통합적 인지의 탄생

멀티모달이라는 용어는 '여러 형태'를 뜻한다. 기존 AI가 텍스트라는 단일 형태의 데이터만 다뤘다면, 멀티모달 AI는 텍스트, 이미지, 영상, 음성을 동시에 처리한다. 사진을 보여주며 “이게 뭐야?”라고 물으면 설명하고, “이 스타일로 새 그림을 그려줘"라고 하면 생성해낸다. 회의 녹음 파일을 건네며 "핵심 내용을 요약해줘”라고 요청하면 음성을 텍스트로 변환한 뒤 요약본까지 만들어준다.

기술적으로 보면 이 과정은 기존 인공지능 원리의 확장이다. AI는 텍스트를 토큰이라는 숫자 조각으로 변환해 처리했는데, 이제 이미지와 영상도 같은 방식으로 처리한다. 사진 한 장이 수백 개의 숫자 조각으로 쪼개지고, 텍스트 토큰과 함께 하나의 신경망 안에서 처리된다. 중요한 것은 단순히 여러 감각을 가졌다는 사실보다, 서로 다른 감각이 하나의 의미 공간에서 만나 상호 참조하기 시작했다는 점이다. 이제 AI는 ‘사과’라는 단어를 볼 때 빨간색을 떠올리고, 아삭한 소리를 들을 때 사과의 텍스트 정보를 함께 연산한다.

2. 왜 이것이 중요한 변화인가

텍스트와 이미지의 차이는 단순히 형식의 차이가 아니다. 텍스트는 세상을 언어로 한 차례 번역하고 추상화한 결과물인 반면, 이미지는 세상을 훨씬 직접적이고 밀도 있게 담고 있다.

‘사과’라는 두 글자 자체에는 색깔, 크기, 품종, 상태에 대한 구체적인 정보가 없다. 그저 ‘사과’라는 범주를 가리킬 뿐이다. 하지만 사과 사진 한 장에는 이 모든 정보가 날것 그대로 담겨 있다. 홍옥인지 부사인지, 익었는지 덜 익었는지, 상처가 있는지 없는지까지. 사진 한 장이 담고 있는 정보량은 단어 하나와 비교할 수 없을 만큼 방대하다.

이것이 우리가 멀티모달에 주목해야 하는 이유다. AI가 이미지와 영상을 학습하기 시작하면서, 언어라는 추상화 단계를 건너뛰고 세상을 더 직접적으로 학습할 수 있게 되었다. 텍스트만으로는 ‘뜨겁다’라는 단어가 다른 단어들과 어떤 관계를 맺는지만 학습할 수 있을 뿐, 실제 뜨거움이 무엇인지는 알 수 없었다. 하지만 이제 AI는 불이 붙은 장면, 연기가 피어오르는 영상, 화상을 입은 피부 사진을 학습한다. 여전히 뜨거움을 인간처럼 느끼지는 못하지만, 시각적 현상을 확률적으로 재현하고 추론하는 과정을 통해 그 개념의 실체에 훨씬 가까이 다가가게 된 것이다.

3. 무엇이 가능해졌는가

멀티모달 AI가 가져온 변화는 단순히 보는 것을 넘어, 그동안 인간만이 가졌던 안목의 영역을 데이터화하고 있다.

의료 현장에서 AI는 이미 영상 판독을 보조하고 있다. 중요한 것은 이것이 단순히 의학 교과서를 학습해서는 도달할 수 없었던 영역이라는 점이다. AI는 이제 X-ray나 CT 이미지 속의 미묘한 패턴을 읽고, 동시에 입력된 환자의 차트를 상호 참조하여 진단을 도출한다. 이미지로 입력하고 텍스트로 답을 얻는 이 상호작용은 전문가의 안목을 누구나 빌려 쓸 수 있게 만든다.

사진 한 장으로 가상공간을 복원하는 기능은 AI가 보이지 않는 것까지 추론해낸 결과다. 평면적인 사진에는 담기지 않은 공간의 깊이와 그림자 너머의 구조를 AI가 시뮬레이션한다. 부동산 앱에서 방 사진 몇 장만으로 내부를 걸어 다니듯 둘러볼 수 있게 된 것도 이 기술 덕분이다. 데이터는 이제 보는 대상을 넘어 우리가 걸어 들어가는 영토가 되었다.

과거의 AI가 “고양이가 있다”는 객체 인식에 그쳤다면, 지금의 멀티모달은 “고양이가 창밖을 보며 누군가를 기다리고 있다”는 상황까지 파악한다. 개별 요소를 인식하는 것을 넘어, 요소들 사이의 관계와 전체적인 맥락을 읽어내는 것이다. 더 나아가 최신 기술인 월드 모델은 비가 올 때 노면에 반사되는 빛이나 물체의 운동을 시뮬레이션하며, 영상 데이터 속에 숨겨진 물리적 개연성을 확률적으로 추론해낸다.

4. 감각은 확장되었지만, 본질은 같다

멀티모달 AI의 등장으로 활용 가능한 영역이 폭발적으로 넓어진 것은 분명하다. 텍스트만으로는 접근할 수 없었던 의료, 제조, 건축, 보안 등 ‘보는 것’이 핵심인 분야에서 AI가 실질적인 역할을 하기 시작했다.

하지만 AI는 여전히 완벽하지 않다. 이미지를 처리하게 되었다고 해서 세상을 완전히 이해하게 된 것은 아니다. 이미지 생성 AI가 손가락을 여섯 개 그리거나, 영상 생성 AI가 물리 법칙을 무시하는 장면을 만들어내는 오류들은 텍스트에서의 환각이 이미지와 영상으로 확장된 것일 뿐이다.

그럼에도 변화의 방향은 분명하다. 텍스트 중심 시대에는 프롬프트라는 언어적 질문이 중요했다면, 멀티모달 시대에는 AI에게 무엇을 보여주고 어떻게 물을 것인가가 핵심 역량이 된다. 정보를 읽는 시대를 지나 세계의 본질을 데이터로 재구성하기 시작한 지능은, 이제 우리 대신 복잡한 업무를 스스로 완수하는 에이전트의 시대로 우리를 안내한다.

김민지/데이터엔지니어